W swoim komunikacie prasowym, zespół ElevenLabs pisze: „naszą misją w ElevenLabs jest tworzenie narzędzi audio AI, które poprawiają dostępność treści, przełamują bariery językowe, poprawiają doświadczenia użytkowników i oferują nowe możliwości twórcze. Nasza współpraca z rabbit, twórcami towarzysza r1 AI, przyczyni się do realizacji tej misji i ustanowi nowy standard komunikacji między użytkownikiem a urządzeniem. Gdy użytkownicy r1 wykonują zaawansowane polecenia głosowe, głos zasilany przez ElevenLabs odezwie się z niezrównanym realizmem i niskim opóźnieniem.

– Współpracujemy z firmą rabbit, aby przybliżyć przyszłość interakcji człowieka z urządzeniem. Nasza współpraca ma na celu uczynienie z r1 prawdziwie dynamicznego drugiego pilota – mówi Mati Staniszewski, dyrektor generalny ElevenLabs.

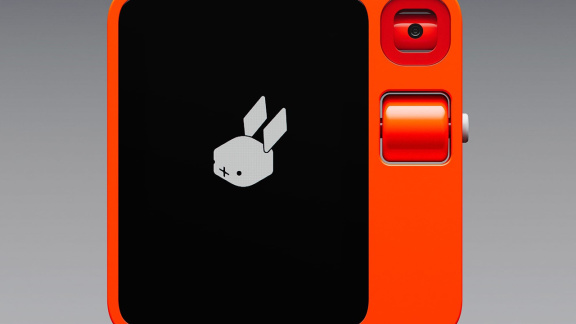

– Chcieliśmy, aby korzystanie z r1 było płynne i intuicyjne, więc zbudowaliśmy go jako samodzielne urządzenie, które wykorzystuje język naturalny, aby pomóc Ci załatwić sprawę. Dzięki r1 możesz po prostu nacisnąć przycisk i rozmawiać z nim tak, jakbyś rozmawiał z osobistym asystentem. Modele głosowe ElevenLabs o ultra wysokiej jakości i niskim opóźnieniu sprawiają, że ta interakcja jest bardzo naturalna – powiedział Jesse Lyu, założyciel i dyrektor generalny rabbit.

Przedstawiciele rabbit informują, że r1 AI OS opiera się na „Large Action Model”. Sami swoje urządzenie nazywają „rodzajem uniwersalnego kontrolera dla aplikacji.”

W swojej recenzji urządzenia, David Pierce z The Verge pisał tak: „Rabbit OS może sterować muzyką, zamawiać samochód, kupować artykuły spożywcze, wysyłać wiadomości i nie tylko, a wszystko to za pośrednictwem jednego interfejsu. Po prostu poproś o to, czego chcesz i pozwól urządzeniu Ci to zapewnić. Interfejs ekranowy R1 będzie serią kart opartych na kategoriach, dla muzyki, transportu lub czatów wideo, a Lyu [Jesse Lyu, founder i dyrektor generalny startupu] twierdzi, że ekran istnieje głównie po to, abyś mógł samodzielnie zweryfikować wydajność modelu.”